2026년 들어 AI 에이전트 도구 중에서 가장 빠르게 이름을 알린 것이 OpenClaw다. 오픈소스로 공개된 지 얼마 되지 않아 GitHub 스타가 247,000개를 넘었고, 포크 수도 47,700개에 달한다.

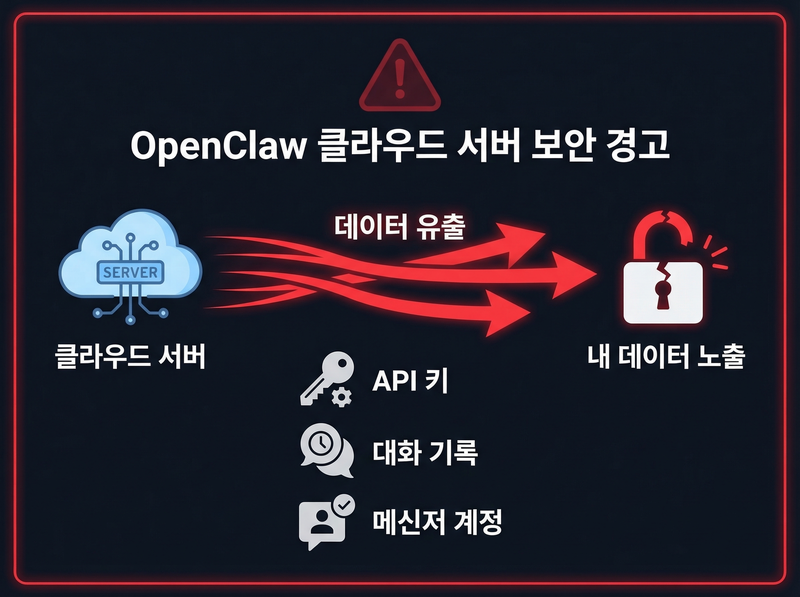

문제는 이 도구가 강력한 만큼 잘못 설정하면 API 키, 대화 기록, 심지어 메신저 계정 정보까지 인터넷에 그대로 노출될 수 있다는 점이다. 그래서 보안을 신경 쓰는 사람들 사이에서 맥미니 M4를 구입해 로컬에서 직접 돌리는 방식이 빠르게 퍼지고 있다. 어떤 이유로 맥미니 AI 로컬 구성이 최선인지, 모델은 어떤 걸 골라야 하는지 정리했다.

OpenClaw란? 왜 갑자기 주목받나

OpenClaw는 오스트리아 개발자 Peter Steinberger가 만든 오픈소스 자율 AI 에이전트다. 쉽게 말하면, WhatsApp이나 Telegram, Signal 같은 메신저 앱을 AI 명령 센터로 바꿔주는 도구다. 메신저에 “이 폴더를 정리해줘”라고 입력하면 실제로 터미널 명령을 실행하고, 브라우저를 자동화하고, 로컬 파일을 관리하는 수준까지 작동한다.

연동되는 AI 모델도 폭넓다. Claude, DeepSeek, OpenAI GPT 중 원하는 것을 골라 붙일 수 있고, 인터넷이 없어도 로컬 LLM을 직접 연결해 완전히 오프라인으로 쓸 수도 있다. 2026년 1월 말 급부상하기 시작해 불과 한 달여 만에 AI 에이전트 카테고리에서 가장 많이 언급되는 이름이 됐다.

그런데 기능이 강력할수록 리스크도 크다. AI 에이전트가 셸 명령을 직접 실행할 수 있다는 건, 설정이 잘못되면 시스템 관리자 권한으로 아무 명령이나 실행될 수 있다는 뜻이다. 이 부분을 제대로 이해하지 않고 클라우드 서버에 올려두면 어떤 일이 생기는지가 바로 다음 섹션에서 나온다.

클라우드 OpenClaw의 보안 위험, 얼마나 심각할까

2026년 1월, 보안 업체 Censys가 인터넷을 스캔한 결과 21,639개의 OpenClaw 인스턴스가 인증 없이 누구나 접근할 수 있는 상태로 노출되어 있었다. 기본 설정에서 bind address가 127.0.0.1이 아닌 0.0.0.0으로 잡히면 외부에서 바로 접근 가능해지는데, 이걸 모르고 클라우드에 올린 사람들이 많았던 것이다.

노출된 정보는 상상 이상이었다. Anthropic이나 OpenAI API 키, Telegram 봇 토큰, Slack 계정, 수개월치 대화 기록 전체가 탈취 위험에 놓였다. API 키 하나가 새면 그 키로 발생하는 모든 요금이 자기 청구서에 찍힌다. 같은 시기 보안 감사에서는 512개의 취약점이 발견됐고, 그 중 8개가 치명적(critical) 등급이었다. CVE-2026-25253이라는 토큰 탈취 버그는 2026년 1월 29일에야 패치됐다.

더 근본적인 문제가 있다. OpenClaw를 클라우드 서버에서 돌린다는 건, AI 에이전트가 주고받는 모든 데이터가 결국 외부 서버를 통한다는 뜻이다. 보안 패치를 다 적용해도 데이터가 내 손을 떠나는 순간 완전한 통제는 불가능하다. 그래서 진지하게 사용하는 사람들이 로컬 설치 쪽으로 눈을 돌리고 있는 것이다.

왜 맥미니 M4가 OpenClaw 로컬 실행에 최적인가

로컬 실행을 결정했다면 다음 질문은 하드웨어다. Raspberry Pi도 있고, Windows 미니PC도 있고, 중고 노트북도 선택지가 된다. 그런데 실제로 OpenClaw를 24시간 켜두고 쓰는 사람들 사이에서 맥미니 M4가 압도적으로 많이 선택되는 데는 이유가 있다.

M4 Neural Engine: 초당 38조 연산의 AI 두뇌

맥미니 M4에는 16코어 Neural Engine이 탑재되어 있다. 초당 38조 연산(38 TOPS)을 처리하는 수준인데, 그 이유는 AI 추론 작업이 전통적인 CPU 연산과는 다른 방식으로 처리되기 때문이다. Neural Engine은 행렬 곱셈과 벡터 연산에 특화되어 있어 같은 작업을 CPU로 돌릴 때와 전력 대비 성능이 완전히 다르다.

통합 메모리 아키텍처도 핵심이다. CPU, GPU, Neural Engine이 하나의 고속 메모리 풀을 공유하기 때문에 AI 모델이 추론할 때 데이터를 복사하는 오버헤드가 없다. M4의 메모리 대역폭은 120GB/s, M4 Pro는 273GB/s다. 일반 PC에서 CPU와 GPU가 각자 별도 메모리를 쓰는 구조와 비교하면, 같은 크기의 모델을 훨씬 빠르게 실행할 수 있다는 뜻이다. M4 Pro의 Neural Engine 속도는 M1 대비 3배 이상 빠르다는 게 Apple 공식 자료에서 확인되는 수치다.

전기요금 월 1~2달러, 24시간 켜두는 AI 서버

OpenClaw를 제대로 쓰려면 항상 켜져 있어야 한다. 메신저에서 명령을 보내는 순간 바로 응답해야 하니까. 그런데 데스크탑 PC를 24시간 켜두면 전기요금이 부담이 된다. 맥미니 M4는 대기 상태에서 1.3W, 실제 OpenClaw 워크로드를 처리할 때도 최대 25~30W 수준이다.

이걸 한 달 24시간 기준으로 계산하면 전기요금이 1~2달러 수준에 불과하다. 클라우드 VPS를 빌리면 비슷한 사양에서 월 10~50달러가 나간다. 1~2년 운용하면 맥미니 구입 비용을 고려해도 장기적으로 비용이 낮아지는 구조다. 소음도 없다. 쿨링 팬이 있기는 하지만 일반 작업 환경에서는 거의 들리지 않아 서재나 침실에 두고 켜둬도 신경 쓰이지 않는 수준이다.

macOS 생태계, Ollama 설정 없이 바로 실행

로컬 LLM을 돌리는 가장 대중적인 도구가 Ollama인데, Ollama가 Apple Silicon에서 Metal GPU 가속을 네이티브로 지원한다. 별도 드라이버 설치도 필요 없고, GPU 설정을 만질 필요도 없다. 설치하면 바로 Metal 가속으로 모델을 실행한다.

Linux 기반 미니PC에서 GPU를 활용하려면 CUDA나 ROCm 드라이버를 맞게 설치하고, 모델과 라이브러리 버전을 맞추는 작업이 필요하다. 처음 해보는 사람이라면 여기서 몇 시간을 쓰기 쉽다. 맥미니는 그 과정이 없다. OpenClaw와 Ollama를 설치하면, 그게 로컬 AI 에이전트 환경의 전부다.

손바닥만 한 크기, 책상 어디든 들어간다

맥미니 M4의 크기는 12.7cm x 12.7cm x 5.0cm다. 이전 모델이 19.7cm x 19.7cm였던 걸 생각하면 가로세로가 1/3 이상 줄었다. 모니터 받침대 뒤, 책상 한쪽 모서리, 서랍장 위 어디든 그냥 올려두면 된다. 서버라고 부르기가 민망할 만큼 작다.

전면에 Thunderbolt 4 포트가 2개 있어 외부 저장소를 빠르게 연결할 수 있다. 외장 SSD에 모델 파일을 저장해두고 필요할 때만 꽂는 방식도 충분히 쓸 만하다. 디스플레이는 별도로 연결해야 하지만, 서버 용도라면 헤드리스로 두고 SSH나 원격 접속으로만 사용하는 경우도 많다.

맥미니 M4 모델 추천: 내 OpenClaw 사용 목적에 맞는 선택은?

맥미니 AI 로컬 설치를 위한 최적의 모델을 선택하는 것이 구매 결정의 핵심이다. 맥미니 M4는 이렇게 생겼다. 손바닥보다 약간 큰 12.7cm 정사각형 본체 하나로, OpenClaw AI 에이전트 서버가 된다. 메모리는 구입 후 업그레이드가 불가능하니 처음 선택이 중요하다. 어떤 용도로 쓸지에 따라 맞는 모델이 달라진다.

클라우드 API 활용, 기본 에이전트 목적: M4 16GB 기본형

Claude API나 ChatGPT API를 OpenClaw에 연결해서 쓸 계획이라면 16GB로 충분하다. 로컬에서 LLM 모델 자체를 돌리는 게 아니라 AI API를 호출하는 방식이기 때문에, OpenClaw 런타임과 에이전트 처리에 필요한 메모리만 있으면 된다. 맥미니 AI 입문으로 가장 접근하기 쉬운 구성이다.

10코어 CPU와 10코어 GPU, 16GB LPDDR5X 메모리 조합으로 89만 원대부터 시작한다(작성일 기준, 변동 가능). 먼저 가볍게 시작하고 싶다면 이 모델부터다.

로컬+클라우드 혼합 사용: M4 24GB 또는 M4 Pro 기본형

7B~13B 규모의 로컬 모델과 클라우드 API를 상황에 따라 골라 쓰는 패턴이라면 24GB가 적합하다. 로컬 모델을 메모리에 올려두면서 OpenClaw가 병렬로 여러 작업을 처리해야 할 때 16GB는 빠듯해지기 시작한다.

M4 24GB는 149만 원대, M4 Pro 24GB는 209만 원대다(작성일 기준, 변동 가능). 두 모델의 가격 차이만큼 성능 차이도 있다. M4 Pro는 메모리 대역폭이 273GB/s로 M4(120GB/s)보다 2배 이상 높아 로컬 모델을 자주 돌린다면 응답 속도에서 체감 차이가 난다. 13B 이하 모델을 주력으로 로컬 실행하는 사람이라면 M4 Pro 24GB가 가성비 측면에서 의미 있는 선택이다.

70B 대형 모델 완전 로컬 실행: M4 Pro 48GB 이상

Llama 3.1 70B, DeepSeek 67B 같은 대형 모델을 API 없이 완전히 로컬에서 돌리고 싶다면 48GB 이상이 필요하다. 모델 자체가 메모리를 많이 잡는데, 여기에 OpenClaw 런타임과 운영체제 메모리까지 더하면 24GB로는 모자란다.

M4 Pro 48GB는 269만 원대에서 시작한다(작성일 기준, 변동 가능). API 비용 걱정 없이 모든 처리를 집 안에서 완결하고 싶고, 데이터 주권을 완전히 확보하는 게 목표라면 이 선택이 맞다.

| 모델 | 메모리 | 가격 (작성일 기준) | 추천 용도 |

|---|---|---|---|

| M4 기본형 | 16GB | 89만 원대~ | 클라우드 API 연동, 입문자 |

| M4 | 24GB | 149만 원대~ | 로컬+클라우드 혼합 |

| M4 Pro | 24GB | 209만 원대~ | 로컬 모델 중심, 빠른 응답 |

| M4 Pro | 48GB | 269만 원대~ | 70B급 대형 모델 완전 로컬 |

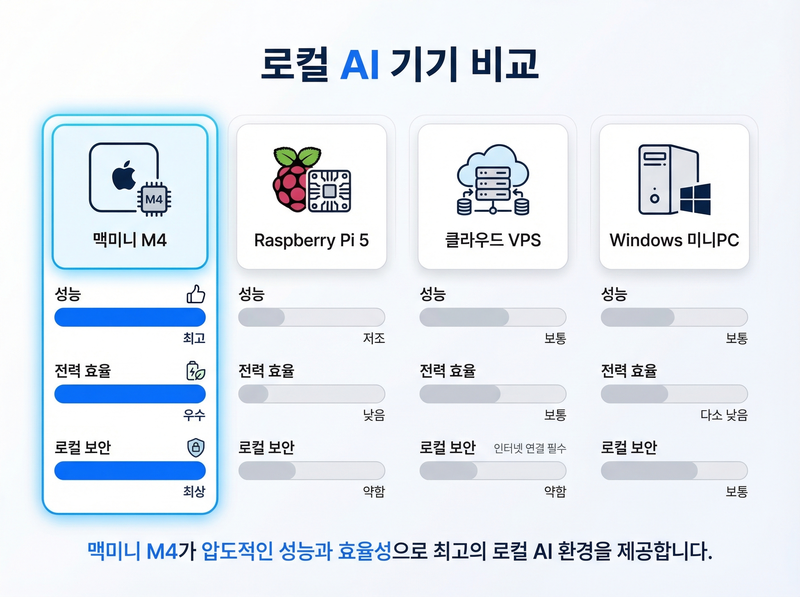

맥미니 vs 다른 선택지, 왜 맥미니인가

Raspberry Pi 5도 저전력이고 가격도 저렴하다. 그런데 실제 AI 추론 성능을 비교하면 맥미니 M4 대비 10~20배 느리다. OpenClaw가 복잡한 명령을 처리할 때 체감 응답 지연이 생기기 시작하는 수준이다. 메신저에 명령을 보냈는데 몇 분씩 기다려야 한다면 실사용에서 만족도가 떨어진다.

클라우드 VPS는 앞서 얘기한 것처럼 보안 문제가 근본적으로 해결되지 않는다. 데이터가 외부 서버를 통한다는 사실 자체가 변하지 않는다. Windows 미니PC는 성능 자체는 비슷하게 맞출 수 있지만, Ollama의 Metal GPU 가속을 쓸 수 없고 초기 환경 구성이 복잡하다. 처음 세팅할 때 여러 시도를 거쳐야 하는 경우가 많다.

| 기기 | AI 추론 성능 | 전력 효율 | 로컬 AI 설정 난이도 | 데이터 보안 |

|---|---|---|---|---|

| 맥미니 M4 | 최상 | 최상 | 쉬움 | 완전 로컬 |

| Raspberry Pi 5 | 하 | 상 | 중간 | 완전 로컬 |

| 클라우드 VPS | 중 | 해당 없음 | 쉬움 | 외부 전송 |

| Windows 미니PC | 중상 | 중 | 어려움 | 완전 로컬 |

성능, 저전력, macOS 생태계 이 세 가지를 동시에 충족하는 기기는 맥미니 M4뿐이다. 특히 AI 로컬 실행을 처음 시도하는 사람이라면 셋업이 얼마나 간단한지가 진입 장벽을 결정하는데, 그 측면에서 맥미니는 다른 선택지와 비교가 되지 않는다.

OpenClaw 로컬 설치 시 보안 설정 핵심 3가지

맥미니에 OpenClaw를 설치했다고 해서 자동으로 보안이 완벽한 건 아니다. 로컬에 설치한 건 외부 서버 의존을 없앤 것이고, 설정을 제대로 해야 21,000개 인스턴스 노출 사태 같은 일을 막을 수 있다. 핵심 세 가지만 챙기면 대부분의 위험은 차단된다.

- bind address를 127.0.0.1로 설정. 기본값이 0.0.0.0으로 되어 있으면 외부 네트워크에서 OpenClaw 인터페이스에 직접 접근할 수 있다. 반드시 127.0.0.1(localhost)로 바꿔야 한다. 이 설정 하나로 외부 노출의 대부분을 막는다.

- 전용 macOS 계정 생성. 평소 쓰는 관리자 계정 그대로 OpenClaw를 돌리지 말고, 별도 계정을 만들어 권한을 제한하는 게 좋다. AI 에이전트가 셸 명령을 실행할 때 관리자 계정이면 시스템 전체에 영향을 줄 수 있기 때문이다.

- Little Snitch 또는 LuLu로 아웃바운드 모니터링. OpenClaw가 예상치 못한 외부 서버로 데이터를 보내는지 감시하는 네트워크 도구다. 둘 다 macOS 전용으로, 어떤 프로세스가 어디로 통신하는지 한눈에 보여준다. 이상한 연결이 생기면 바로 차단할 수 있다.

설치 후 이 세 가지를 확인하는 데 걸리는 시간은 30분이 채 안 된다. 그 30분으로 잠재적 피해를 막을 수 있다면 안 할 이유가 없다.

OpenClaw를 제대로 활용하고 싶다면 결국 로컬 설치가 답이고, 로컬 설치의 최적 환경은 맥미니 M4다. API 연동이 목적이라면 M4 16GB, 로컬 모델을 섞어 쓸 계획이라면 M4 Pro 24GB, 70B 이상 대형 모델까지 돌리고 싶다면 M4 Pro 48GB 이상을 선택하면 된다. 메모리는 나중에 바꿀 수 없으니 처음에 한 단계 넉넉하게 고르는 게 낫다는 얘기를 많이 한다.

답글 남기기